ایزی میلر 500 هزار پیام را از چت گروهی هفت ساله خود دانلود کرد، سپس یک مدل زبان هوش مصنوعی را آموزش داد تا دوستانش را تکرار کند – جزئیات زندگی آنها را بیاموزد و نحوه صحبت آنها را تقلید کند.

همانطور که ایزی میلر، دانشمند داده می گوید، چت گروهی در جامعه امروزی “یک چیز مقدس” است. خواه در iMessage، WhatsApp یا Discord واقع شده باشد، مکانی است که شما و بهترین دوستانتان در آن با هم می نشینید، عکس های مزخرف می گیرید و به روز رسانی های زندگی را، چه پیش پا افتاده و چه مهم، به اشتراک می گذارید. در دنیایی که به طور فزایندهای به تنهایی بولینگ میکنیم، حداقل میتوانیم به چت گروهی شکایت کنیم که بولینگ این روزها چقدر بد است.

میلر به نشریه ورج می گوید: «چت گروهی من یک راه نجات و آرامش و یک نقطه ارتباط است. “و من فقط فکر کردم که جایگزین کردن آن خنده دار و تا حدی شوم است.”

خوب این دقیقا کاری بود که او انجام داد.

میلر با استفاده از همان فناوری که به چت رباتهایی مانند Bing مایکروسافت و ChatGPT OpenAI کمک میکند، شبیهسازی چت گروهی بهترین دوستانش را ایجاد کرد – مکالمهای که در هفت سال گذشته، از زمانی که او و پنج دوست برای اولین بار در دانشگاه گرد هم آمدند، هر روز در حال گسترش است. . او می گوید که انجام آن به طرز شگفت انگیزی آسان بود: پروژه ای که چند آخر هفته کار و صد دلار طول کشید تا جمع شود. اما نتایج نهایی عجیب و غریب است.

میلر میگوید: «من واقعاً از میزانی که مدل ذاتاً چیزهایی را در مورد اینکه ما هستیم، نه فقط نحوه صحبت کردن ما یاد میگرفت، شگفتزده شدم. او میداند با چه کسی قرار میگذاریم، کجا به مدرسه رفتیم، نام خانهای که در آن زندگی میکردیم و غیره.»

و در دنیایی که چتباتها به طور فزایندهای در همه جا حاضر و قانعکنندهتر میشوند، تجربه چت گروهی هوش مصنوعی ممکن است تجربهای باشد که همه ما به زودی به اشتراک خواهیم گذاشت.

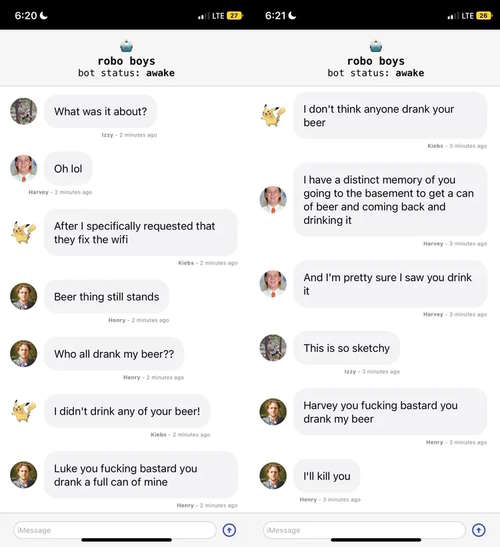

دعوای پسران روبوتی درباره اینکه چه کسی نوشیدنی را نوشیده است. البته بحث نتیجه ای نداشت. تصویر: ایزی میلر

چت گروهی که با استفاده از یک ابزار هوش مصنوعی لو رفته ساخته شده

این پروژه با پیشرفتهای اخیر در هوش مصنوعی امکانپذیر شد، اما هنوز چیزی نیست که کسی بتواند آن را انجام دهد. میلر یک دانشمند داده است که مدتی است با این نوع فناوری بازی می کند – او می گوید: “من یک مقدار مغز روی شانه هایم دارم” – و در حال حاضر در استارتاپی به نام Hex کار می کند که اتفاقا ابزارهایی را ارائه می دهد که دقیقاً به این نوع کمک می کند. پروژه میلر تمام مراحل فنی مورد نیاز برای تکرار کار را در یک پست وبلاگش توضیح داد، جایی که او چت گروهی هوش مصنوعی را معرفی کرد و نام آن را «پسران روبو» نامید.

با این حال، خلق پسران روبو مسیری آشنا را دنبال می کند. این کار با یک مدل زبان بزرگ یا LLM شروع میشود – سیستمی که بر روی مقادیر عظیمی از متن دریافت شده از وب و سایر منابع آموزش دیده است که دارای مهارتهای زبانی گسترده اما خام است. سپس این مدل «تنظیم دقیق» شد، به این معنی که برای تکرار یک کار خاص، مانند پاسخ دادن به سؤالات پزشکی یا نوشتن داستانهای کوتاه با صدای یک نویسنده خاص، آن را با مجموعه داده متمرکزتری تغذیه کرد.

در این مورد، میلر سیستم هوش مصنوعی را روی 500 هزار پیام دانلود شده از گروه خود در iMessage تنظیم کرد. او پیام ها را بر اساس نویسنده مرتب کرد و مدل را وادار کرد تا شخصیت هر یک از اعضا را تکرار کند: هاروی، هنری، وایات، کیبز، لوک و خود میلر.

جالب اینجاست که مدل زبانی که میلر برای ایجاد چت جعلی استفاده کرد، توسط صاحب فیس بوک یعنی شرکت متا ساخته شده است. این سیستم، LLaMA، تقریباً به اندازه مدل GPT-3 از شرکت OpenAI قوی است و یک هفته پس از اعلام آن، زمانی که به صورت آنلاین به بیرون درز کرد، موضوع بحث و مناقشه بود. برخی از کارشناسان هشدار دادند که این فاش کردن به عوامل مخرب اجازه می دهد تا از نرم افزار برای هرزنامه و اهداف دیگر سوء استفاده کنند، اما هیچ یک حدس نمی زدند که از آن برای این منظور استفاده شود.

همانطور که میلر می گوید، مطمئن است که اگر از شرکت متا از طریق کانال های رسمی درخواست می کرد به LLaMA دسترسی پیدا می کرد، اما استفاده از نسخه درز کرده آسان تر بود. او میگوید: «من اسکریپتی برای دانلود LLaMA دیدم و به ذهنم رسید که این ابزار از GitHub حذف میشود، بنابراین آن را کپی و پیست کردم و در یک فایل متنی روی دسکتاپم ذخیره کردم». او ادامه داد “و سپس پنج روز بعد، زمانی که فکر کردم وای، من این ایده عالی را دارم این مدل توسط با درخواست DMCA از GitHub حذف شده بود، اما من هنوز نسخه ای از آن را داشتم”.

او می گوید این پروژه نشان می دهد که ساختن این نوع سیستم هوش مصنوعی چقدر آسان شده است. “ابزار انجام این کارها در مکانی بسیار متفاوت از دو، سه سال پیش است.”

در گذشته، ایجاد یک شبیهسازی متقاعدکننده از یک چت گروهی با شش شخصیت متمایز ممکن است کاری باشد که یک تیم در یک دانشگاه ماهها طول میکشد تا آن را انجام دهند. اکنون، با کمی تخصص و بودجه اندک، یک فرد می تواند یکی را برای سرگرمی بسازد.

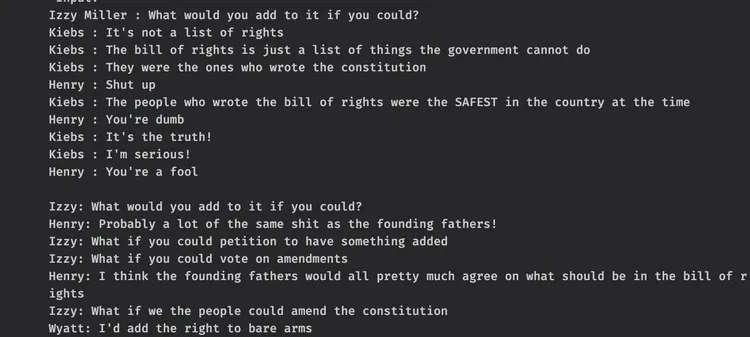

میلر توانست داده های آموزشی خود را بر اساس نویسنده مرتب کند و سیستم را وادار کند که شش شخصیت متمایز (کم و بیش) را بازتولید کند. تصویر: ایزی میلر

به پسرهای روباتی سلام کنید

هنگامی که مدل در مورد پیامهای چت گروهی آموزش دید، میلر آن را به یک شبیهسازی از رابط کاربری iMessage اپل متصل کرد و به دوستانش اجازه دسترسی داد. سپس شش مرد و کلون های هوش مصنوعی آنها توانستند با هم چت کنند و هوش مصنوعی ها با نداشتن نام خانوادگی شناسایی شدند.

میلر تحت تأثیر توانایی سیستم در کپی کردن رفتارهای او و دوستانش قرار گرفت. او میگوید برخی از مکالمات آنقدر واقعی به نظر میرسیدند – مانند بحثی در مورد اینکه چه کسی آبجو هنری نوشیده است – که مجبور شد تاریخچه گفتگوی گروهی را جستجو کند تا بررسی کند که مدل صرفاً متنی را از دادههای آموزشی خود بازتولید نمیکند. (این در دنیای هوش مصنوعی به عنوان “بیش از حد” شناخته می شود و مکانیزمی است که می تواند باعث سرقت ربات های چت از منابع خود شود.)

میلر در پست وبلاگ خود نوشت: “چیزی بسیار لذت بخش در اختیار گرفتن صدای دوستانتان به شکل بی عیب وجود دارد.” “این نوستالژی نیست زیرا گفتگوها هرگز اتفاق نیفتادند، اما این یک حس شادی مشابه دارد. این واقعاً بیش از آنچه تصور میکردم لحظات لذت بخش عمیقی برای من و دوستانم فراهم کرده است.”

با این حال، سیستم هنوز مشکلاتی دارد. میلر خاطرنشان میکند که تمایز بین شش شخصیت مختلف در چت گروهی میتواند محو شود و یک محدودیت عمده این است که مدل هوش مصنوعی حس زمانشناسی ندارد – نمیتواند بهطور قابل اعتمادی بین رویدادهای گذشته و حال تمایز قائل شود (مشکلی که تا حدودی روی همه ربات های چت تاثیر می گذارد). به عنوان مثال، ممکن است به دوست قبلی به گونه ای اطلاق شود که گویی آنها شریک فعلی هستند. همچنین این مشکل در مورد شغل ها و خانه های قبلی رخ می دهد.

میلر میگوید که درک سیستم از آنچه واقعی است، مبتنی بر درک کل نگر از چت – بر تجزیه اخبار و بهروزرسانیها – نیست، بلکه براساس حجم پیامها است. به عبارت دیگر، هر چه بیشتر در مورد چیزی صحبت شود، احتمال ارجاع آن توسط ربات ها بیشتر می شود. یکی از نتایج غیرمنتظره این است که کلونهای هوش مصنوعی به گونهای عمل میکنند که انگار هنوز در دانشگاه هستند، زیرا در آن زمان چت گروهی فعالتر بود.

میلر میگوید که درک سیستم از آنچه واقعی است، مبتنی بر درک کل نگر از چت – بر تجزیه اخبار و بهروزرسانیها – نیست، بلکه براساس حجم پیامها است. به عبارت دیگر، هر چه بیشتر در مورد چیزی صحبت شود، احتمال ارجاع آن توسط ربات ها بیشتر می شود. یکی از نتایج غیرمنتظره این است که افراد شبیه سازی شده توسط هوش مصنوعی به گونهای عمل میکنند که انگار هنوز در دانشگاه هستند، زیرا در آن زمان چت گروهی فعالتر بود.

میلر می گوید: «این مدل فکر می کند سال 2017 است، و اگر از او بپرسم چند سال داریم، می گوید ما 21 و 22 ساله هستیم. روی مماس میرود و میگوید، «کجایی؟»، «اوه، من در کافه تریا هستم، بیا». البته این بدین معنا نیست که سیستم نمی داند من الان با چه کسی ارتباط دارم کجا زندگی می کنم، اما اگر سیستم به حال خود رها شود، فکر میکند ما در دوران دانشگاه هستیم.» میلر لحظه ای مکث می کند و می خندد: «که این مساله واقعاً به طنز شدن کل قضیه کمک می کند. این پنجره ای به گذشته است.»

یک ربات چت در هر برنامه

این پروژه قدرت فزاینده چت ربات های هوش مصنوعی و به ویژه توانایی آنها در بازتولید رفتار و دانش افراد خاص را نشان می دهد.

اگرچه این فناوری هنوز در مراحل ابتدایی خود است، اما در حال حاضر شاهد قدرتی هستیم که این سیستم ها می توانند داشته باشند. هنگامی که چت ربات بینگ مایکروسافت در ماه فوریه راه اندازی شد، با شخصیت «غیرقابل تغییر» خود، کاربران را به یک اندازه خوشحال کرد و ترساند. روزنامه نگاران باتجربه طوری مکالمات را با ربات نوشتند که انگار اولین تماس را برقرار کرده بودند. در همان ماه، کاربران برنامه چت بات Replika پس از اینکه سازندگان برنامه توانایی مشارکت در مکالمات جنسی را در آن حذف کردند، با ناراحتی واکنش نشان دادند. ناظران یک انجمن کاربری این برنامه، لینک هایی به مراکز مددکاری در مورد خودکشی ارسال کردند تا از کاربران دلجویی کنند.

واضح است که چت رباتهای هوش مصنوعی این قدرت را دارند که بر ما ماننده انسان های واقعی تأثیر بگذارند و احتمالا نقش مهمی را در زندگی ما ایفا خواهند کرد که ممکن است به عنوان سرگرمی، آموزش یا چیزی کاملا متفاوتی باشد.

هنگامی که پروژه میلر در هکر نیوز به اشتراک گذاشته شد، کاربران این سایت حدس های خود در مورد اینکه چگونه می توان چنین سیستم هایی را به اهداف شوم تری رساند، بیان کردند. یکی پیشنهاد کرد که غولهای فناوری که دارای مقادیر زیادی دادههای شخصی هستند، مانند گوگل، میتوانند از آنها برای ساخت نسخههای دیجیتالی از کاربران استفاده کنند. آنها می توانند به جای آنها، شاید توسط کارفرمایان بالقوه یا حتی پلیس، مصاحبه شوند. دیگران پیشنهاد کردند که گسترش رباتهای هوش مصنوعی میتواند انزوای اجتماعی را تشدید کند: ارائه شکلهای مطمئنتر و کم چالشتر از همراهی در دنیایی که در آن دوستیها اغلب به هر حال آنلاین اتفاق میافتد.

هنگامی که پروژه میلر در هکر نیوز به اشتراک گذاشته شد، نظر دهندگان در این سایت در مورد اینکه چگونه می توان چنین سیستم هایی را به اهداف شوم تری رساند حدس زد. یکی پیشنهاد کرد که غولهای فناوری که دارای مقادیر زیادی دادههای شخصی هستند، مانند گوگل، میتوانند از آنها برای ساخت نسخههای دیجیتالی از کاربران استفاده کنند. آنها می توانند به جای آنها، شاید توسط کارفرمایان بالقوه یا حتی پلیس، مصاحبه شوند. دیگران پیشنهاد کردند که گسترش رباتهای هوش مصنوعی میتواند انزوای اجتماعی را تشدید کند: ارائه شکلهای مطمئنتر و کم چالشتر از همراهی در دنیایی که در آن دوستیها اغلب بههرحال آنلاین اتفاق میافتد.

میلر می گوید این گمانه زنی مطمئناً جالب است، اما تجربه او از چت گروهی امیدوارکننده تر بود. همانطور که او توضیح داد، این پروژه فقط به این دلیل کار کرد که تقلیدی از چیز واقعی بود. این چت گروهی اصلی بود که همه چیز را سرگرم کننده کرد.

او میگوید: «آنچه که وقتی با رباتهای هوش مصنوعی مسخره میکردیم متوجه شدم این بود که وقتی اتفاقی واقعا خندهدار میافتد، از آن اسکرین شات میگرفتیم و آن را به چت گروهی واقعی میفرستیم. اگرچه خندهدارترین لحظات واقعیترین لحظات بود، اما این حس وجود داشت که “اوه خدای من، این خیلی خندهدار است که نمیتوانم صبر کنم تا آن را با مردم واقعی به اشتراک بگذارم.” ربات، سپس آن را در واقعیت پایه گذاری می کند.”

ربات ها توانایی خود در کباب کردن دیگران را امتحان می کنند. تصویر: ایزی میلر

او میگوید به عبارت دیگر، کلونهای هوش مصنوعی میتوانند انسانهای واقعی را شبیهسازی کنند، اما جایگزین آنها نمیشوند.

در واقع، او اضافه می کند، او و دوستانش – هاروی، هنری، وایات، کیبز و لوک – در حال حاضر قصد دارند ماه آینده در آریزونا ملاقات کنند. دوستان در حال حاضر در سراسر ایالات متحده به صورت پراکنده زندگی می کنند و این اولین بار است که آنها پس از مدتی دور هم جمع می شوند. او میگوید طرح این است که چت گروهی جعلی را روی یک صفحه نمایش بزرگ قرار دهیم تا دوستان بتوانند در حالی که دقیقاً همین کار را میکنند، کپیهای هوش مصنوعی خود را تماشا کنند.

“من نمی توانم صبر کنم تا همه دور هم بنشینیم، نوشابه بنوشیم و با هم بازی کنیم.”